Les contenus à caractère pédopornographique pullulent sur le net. Ils sont issus de la terrible exploitation d’enfants, et ce qui est montré constitue avant tout un crime réellement perpétré. Ils sont également dangereux pour les gens qui les voient, notamment les enfants.

Ces contenus criminels font donc l’objet de plus en plus de régulations et de détection automatisées. Mais comment concilier la protection des mineurs avec la préservation de la vie privée, la protection des données personnelles, et les libertés fondamentales — sans ouvrir la voie à une surveillance de masse ?

Certaines entreprises, comme Apple, Google et Meta, pratiquent déjà la détection de contenus pédopornographiques sur certains services (hormis les messageries chiffrées de bout en bout comme WhatsApp ou Signal). La France est particulièrement concernée, avec plus de 310 000 signalements reçus. Ces entreprises procèdent volontairement à ces détections grâce à une dérogation européenne à la directive ePrivacy.

Aujourd’hui, le Conseil de l’Europe envisage, dans sa proposition de régulation communément appelée ChatControl, de rendre obligatoire le scan des communications privées pour y détecter les contenus pédopornographiques — y compris sur les applications chiffrées de bout en bout.

En effet, bien que ces contenus soient illégaux, leur détection automatique ne fait pas encore l’objet d’une régulation. Mais une telle mesure généraliserait la surveillance : chaque média échangé par chaque citoyen devrait être scanné. Quelle est aujourd’hui l’efficacité de la détection de contenu à caractère pédocriminel et de leur signalement ?

À lire aussi : Peut-on détecter automatiquement les deepfakes ?

Lutte contre la criminalité et surveillance

Le chiffrement « de bout en bout » (de l’émetteur au récepteur) et sans accès possible aux données par les fournisseurs est de plus en plus populaire avec les applications comme WhatsApp, Signal ou iMessage.

Cependant, depuis 2010, les gouvernements réclament plus fermement l’affaiblissement du chiffrement, tandis que les experts en cybersécurité mettent en garde contre les risques de failles exploitables par des acteurs malveillants.

En effet, une fois les moyens techniques de surveillance instaurés, il est extrêmement difficile de s’assurer qu’ils ne seront pas, par exemple, exploités à des fins de répression politique. On l’a vu avec le logiciel espion Pegasus et, plus récemment, avec l’affaire TeleMessage, quand des membres du gouvernement américain pensaient utiliser une version sécurisée de Signal, alors que leurs communications étaient en fait accessibles quasi publiquement.

Tous les quinze jours, de grands noms, de nouvelles voix, des sujets inédits pour décrypter l’actualité scientifique et mieux comprendre le monde. Abonnez-vous gratuitement dès aujourd’hui !

Détection de contenus à caractère pédocriminel : comment ça marche, techniquement ?

On distingue deux types de contenus à caractère pédocriminel.

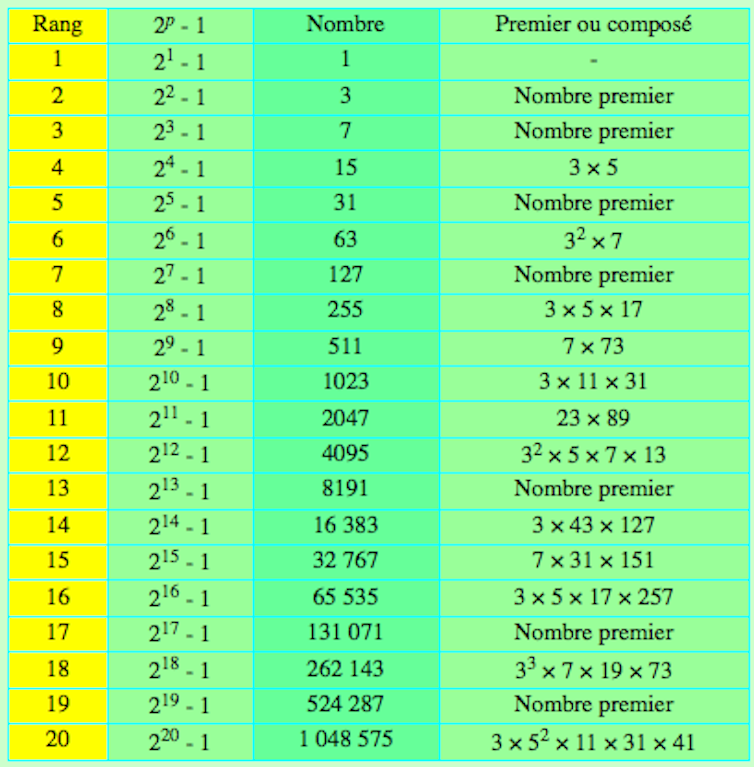

D’une part, les contenus déjà identifiés, qui représentent la grande majorité des contenus à caractère pédocriminel en ligne.

D’autre part, les contenus nouveaux, qu’ils soient réels ou générés par IA (et donc des « faux » à proprement parler, mais présentant quand même un caractère pédocriminel), qui sont très minoritaires en pratique aujourd’hui.

Pour identifier les contenus à caractère pédocriminel connus, on pourrait être tenté de les stocker dans une base de données qui servirait de base de comparaison. Cependant, un tel stockage est illégal dans la plupart des pays, et dangereux (car des personnes pourraient y être exposées).

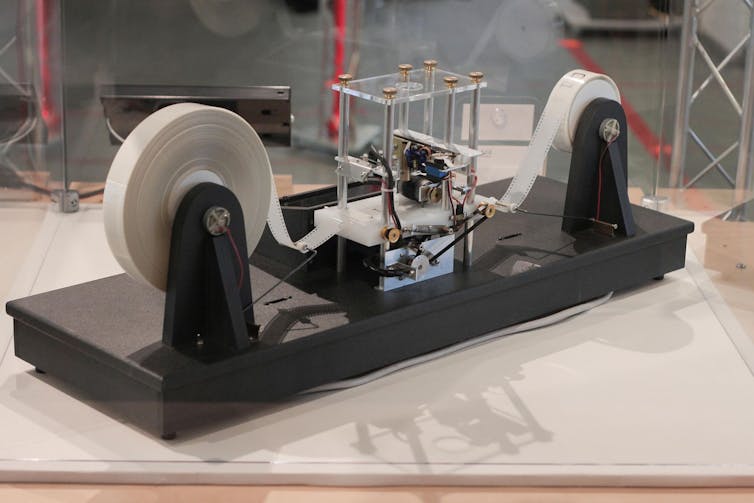

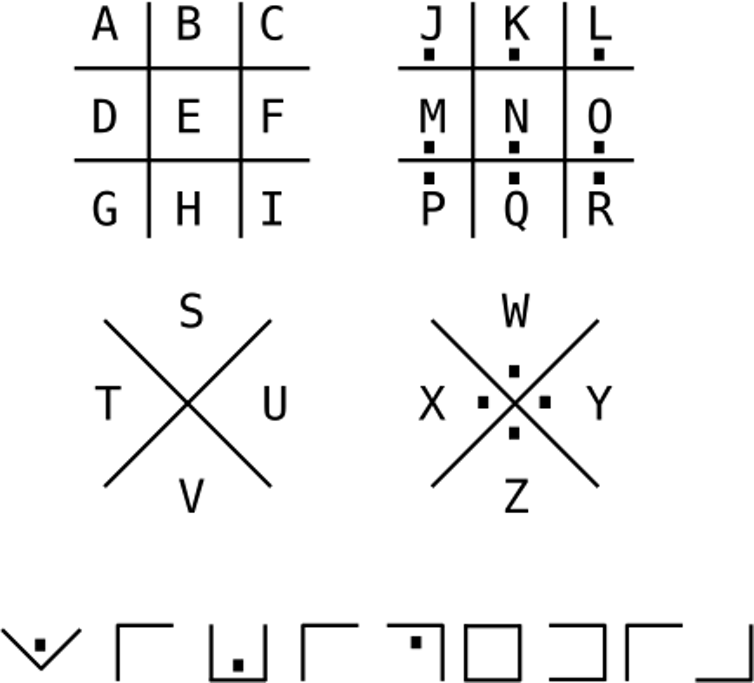

C’est pour cela que les plates-formes – à qui incombe la responsabilité de scanner les contenus — stockent uniquement une « signature », et non les images elles-mêmes. Ces signatures sont générées par des « fonctions de hachage perceptuelles ».

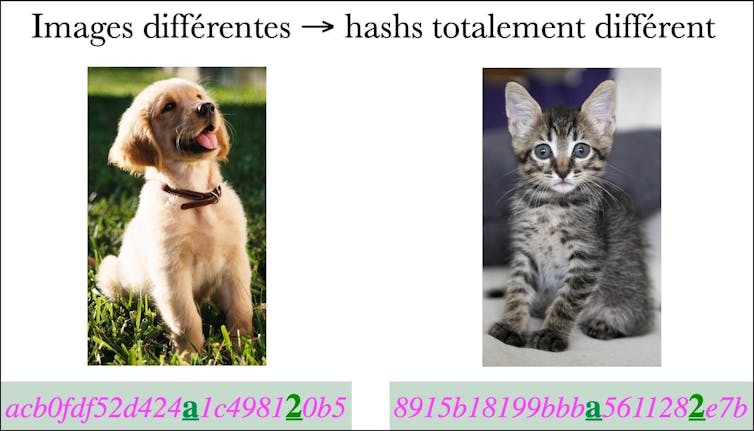

Ces fonctions produisent des signatures similaires pour des contenus visuellement proches. Par exemple, une photo légèrement modifiée (en appliquant un filtre par exemple) conserve une signature proche de celle de la photo d’origine, alors que deux images différentes (un chien et un chat) donneront des signatures bien distinctes.

Ainsi, si une plate-forme veut détecter un contenu à caractère pédocriminel, elle calcule le « haché perceptuel » (la signature) de l’image et le compare aux signatures de contenus connus.

C’est le seul moyen de détection automatique qui existe aujourd’hui — les systèmes d’intelligence artificielle sont pour l’instant moins performants et nécessitent systématiquement une vérification humaine. Il est déjà utilisé à grande échelle, puisque les GAFAM utilisent ce système pour scanner uniquement les informations que les utilisateurs choisissent de partager sur les réseaux sociaux, Internet ou via des messageries non chiffrées de bout en bout.

Signalements de contenus à caractère pédocriminel

Si une correspondance est trouvée entre la signature d’une image d’un utilisateur et celle d’un contenu pédocriminel, l’image est signalée automatiquement au NCMEC (National Center for Missing and Exploited Children ou Centre national pour les enfants disparus et exploités), une organisation américaine à but non lucratif qui centralise et coordonne les signalements à l’échelle mondiale et agit comme un intermédiaire entre les plates-formes numériques, les forces de l’ordre et les autorités nationales. Les plates-formes peuvent également suspendre le compte de l’utilisateur.

En 2023, moins de 64 000 rapports automatiques, sur plus de 36 millions reçus par le NCMEC, ont été reconnus « urgents » par les autorités — soit 0,2 %.

Si aucun organisme n’a communiqué sur l’efficacité réelle des fonctions de hachage perceptuelles, il est établi qu’elles peuvent être attaquées avec succès et que le système de détection peut être mis en échec. Il est par exemple possible de modifier légèrement une image pour que sa signature corresponde à celle d’une image anodine, ce qui permettrait à des individus malveillants de faire passer un contenu dangereux pour anodin (faux négatifs).

Les fonctions de hachage perceptuelles génèrent aussi de nombreux faux positifs : des images différentes peuvent partager la même signature, ce qui pourrait mener à accuser à tort des centaines de milliers de citoyens.

Introduire des portes dérobées

Aujourd’hui, le Conseil de l’Union européenne souhaite rendre la détection obligatoire, y compris aux applications de messageries qui, pour la plupart, ne font pas encore de détection de contenus à caractère pédocriminel.

Or, pour détecter automatiquement des contenus illégaux, il faut y avoir accès… ce qui est compliqué puisqu’une grande part des communications passe par des messageries chiffrées « de bout en bout », c’est-à-dire pour lesquelles un tiers ne peut pas scanner les contenus échangés entre deux personnes.

Rendre la détection possible même sur des messageries chiffrées reviendrait à intégrer une porte dérobée dans le protocole de chiffrement afin de fournir l’accès aux données chiffrées à un tiers. Une telle porte dérobée représente une faille de cybersécurité — ce qui rend cette option inenvisageable en pratique.

À lire aussi : Confidentialité, géolocalisation : la 5G est-elle plus sûre que la 4G et la 3G ?

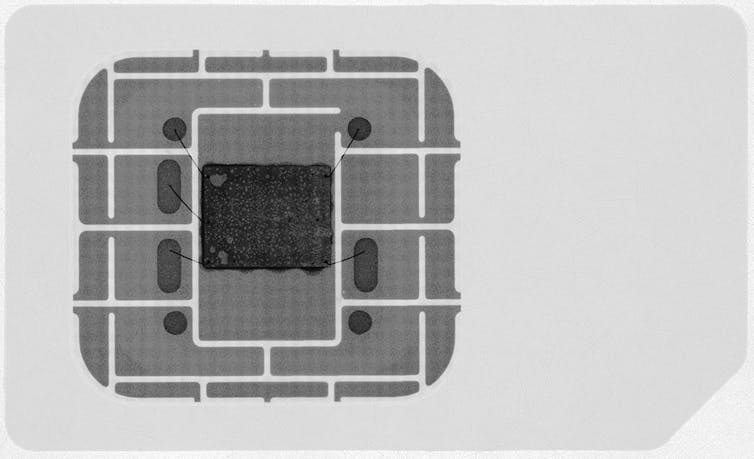

Scanner les photos directement sur les téléphones des utilisateurs

En pratique, ce que recommande donc aujourd’hui le Conseil de l’Union, sur la base d’un rapport technique de 2022 analysant les options disponibles (qui n’ont pas évolué depuis la publication du rapport), c’est de recourir au client-side scanning, c’est-à-dire scanner les photos directement sur les téléphones des utilisateurs.

Cela impliquerait un accès aux photos de tous les appareils en Europe, posant des risques majeurs : détection automatique de contenus légitimes (par exemple des photos d’enfants partagées avec un médecin) ou de nudes échangés volontairement entre adolescents.

De plus, cet accès pourrait permettre la consultation de tout ou partie des photos stockées sur téléphone, sans que les citoyens n’en soient informés, ce qui représenterait une atteinte potentielle à la vie privée, en contradiction avec la Convention européenne des droits de l’homme.

Enfin, l’efficacité limitée des fonctions actuelles pourrait entraîner de nombreux faux positifs, tout en laissant passer des contenus pédocriminels légèrement modifiés.

Le « function creep » : le risque de détournement d’une technologie conçue pour un usage particulier

L’un des principaux dangers liés à l’affaiblissement du chiffrement est le phénomène du « function creep » : une technologie conçue pour un usage précis finit par dériver, au détriment des libertés.

L’histoire de la surveillance numérique montre que des outils mis en place sous couvert de sécurité ont régulièrement été réutilisés pour d’autres finalités, parfois abusives.

Un exemple emblématique est le programme de surveillance PRISM mis en place par la National Security Agency (NSA) des États-Unis. Ce programme illustre bien comment des outils de surveillance créés pour des motifs de sécurité nationale afin de lutter contre le terrorisme (notamment après les attentats du 11 septembre 2001) ont été utilisés pour collecter des données de masse, y compris sur des citoyens ordinaires et des alliés des États-Unis.

De façon semblable, dans un premier temps, les autorités pourraient justifier la nécessité d’un accès aux communications chiffrées par la lutte contre la pédocriminalité et le terrorisme, deux causes auxquelles l’opinion publique est particulièrement sensible. Mais une fois l’infrastructure technique en place, il pourrait devenir tentant d’élargir leur usage à d’autres types d’infractions : criminalité organisée, fraudes, voire délinquance économique.

Ainsi, un système conçu pour détecter des images pédopornographiques dans les messages chiffrés pourrait être détourné pour identifier des documents sensibles partagés par des journalistes d’investigation ou des opposants politiques, comme les affaires Pegasus et Telemessage l’ont montré récemment. Mais finalement, le plus grand problème de ces systèmes imposés à large échelle est simplement qu’ils seront facilement contournés par les criminels.

Le projet DIGISOV ANR-23-CE53-0009 est soutenu par l’Agence nationale de la recherche (ANR), qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Aurélien Francillon a reçu des financements de la commission européenne via le projet ORSHIN (Horizon 101070008), l'ANR via le projet PEPR REV (ANR-22-PECY-0009 France 2030) et les entreprises Eviden et SAP.

Diane Leblanc-Albarel reçoit des financements du Fonds Wetenschappelijk Onderzoek (Fonds de recherche scientifique flamand, FWO).

Francesca Musiani reçoit des financements de l'Agence Nationale de la Recherche (projets ANR DIGISOV et ORA ClaimSov).

Pierrick Philippe a reçu des financements de CREACH LABS.